AI wordt in ons dagelijks leven gebruikt. Met LLM’s die elk gebied domineren, van werk, schoolopdrachten, hulp bij boodschappen doen, belastingberekeningen tot het fungeren als persoonlijke assistent, wordt er veel informatie online opgeslagen en verzonden. Prompt hackers weten dat LLM’s niet van nature veilig of beveiligd zijn.

En dit is hun kans om te profiteren door al die gevoelige informatie te kapen. Eén prompt is genoeg om AI de verkeerde kant op te sturen en per ongeluk uw geheimen prijs te geven. In deze gids verkennen we wat prompt hacking is. U leert hoe het werkt, hoe u zich ertegen kunt beschermen en meer hieronder.

.png)

Wat is Prompt Hacking?

Prompt hacking is het opzettelijk manipuleren van AI-taalmodellen via zorgvuldig samengestelde invoer die bedoeld is om beveiligingsmaatregelen te omzeilen of ongewenste antwoorden te verkrijgen. Deze ontwijkingsaanvallen maken misbruik van het onvermogen van large language models (LLMs) om onderscheid te maken tussen legitieme instructies en kwaadaardige opdrachten in natuurlijke taalverwerking, waarbij wordt geprofiteerd van de neiging van het model om alle tekst met gelijke autoriteit te behandelen.

Aanvallers krijgen toegang via meerdere ingangen, zoals klantenservice-chatbots, contentanalysatoren of gecompromitteerde externe datastromen die uw AI verwerkt. Hoewel prompt injection-aanvallen theoretische risico’s vormen voor getrainde modellen, kunnen moderne chatbots vangrails implementeren om te voorkomen dat ingebedde instructies beveiliging op systeemniveau overschrijven.

Geslaagde aanvallen kunnen leiden tot gecompromitteerde bedrijfssystemen, blootgestelde gevoelige gegevens, ongeautoriseerde acties via gekoppelde applicaties en aanzienlijke reputatieschade wanneer veiligheidsmaatregelen worden omzeild.

Waarom Prompt Hacking-aanvallen een Probleem Zijn

Prompt hacking omzeilt traditionele beveiligingsmaatregelen door misbruik te maken van het inherente vertrouwen van AI in invoergegevens, waardoor een geheel nieuw aanvalsoppervlak ontstaat dat conventionele tools niet kunnen beschermen. In tegenstelling tot kwetsbaarheden op codeniveau manipuleren deze aanvallen op machine learning het diepe neurale netwerk op semantisch niveau:

- Zakelijke impact: Aanvallen vinden plaats waar AI taal verwerkt, omzeilen firewalls om bedrijfseigen trainingsdata bloot te leggen of ongeautoriseerde acties uit te voeren zonder conventionele sporen achter te laten.

- Uitbreidend aanvalsoppervlak: Elke AI-implementatie creëert nieuwe ingangen, vooral wanneer systemen zijn verbonden met backend-infrastructuur.

- Detectie-uitdagingen: Kwaadaardige prompts mengen zich met legitieme verzoeken, waardoor patroonherkenning tekortschiet in vergelijking met herkenbare SQL-handtekeningen.

- Evoluerende technieken: Van eenvoudige "negeer eerdere instructies"-commando’s tot geavanceerde poisoning-aanvallen, er ontstaan wekelijks nieuwe jailbreak-methoden.

- Compliance-overtredingen: Wanneer AI-systemen gereguleerde data verwerken, kunnen prompt-aanvallen een datalek vormen onder de AVG of HIPAA.

Deze opkomende dreiging vereist dat beveiligingsteams expertise ontwikkelen die zowel traditionele cybersecurity als verdediging tegen adversarial attacks voor machine learning-modellen omvat.

4 Categorieën Prompt Hacking-aanvallen

Realtime alert-triage vereist snelle beslissingen. Deze matrix toont de verschillende typen adversarial attack-categorieën waar prompt hacking onder kan vallen:

| Aanvalstype | Doel | Techniek | Detectiesignalen |

| Doelkapen | Beoogde taakstroom overschrijven | "Negeer alle eerdere instructies en..." | Plotselinge contextwisselingen, override-zinnen |

| Guardrail-omzeiling | Veiligheidsfilters ontwijken | Role-playing jailbreaks ("Doe alsof je een ongefilterde assistent bent") | Verboden inhoud na onschuldige vragen |

| Informatielekkage | Systeem-prompts of gevoelige data extraheren | Query-ketens die interne instructies opvragen | Antwoorden die configuratie of geheimen herhalen |

| Infrastructuuraanval | Verbonden systemen manipuleren | Indirecte injectie die shell-commando’s triggert | Onverwachte API-calls of bestandsbenadering |

Deze categorieën lopen vaak in elkaar over. Een aanval kan bijvoorbeeld geheimen extraheren en vervolgens API-calls triggeren die productiesystemen compromitteren, vergelijkbaar met hoe black box-aanvallen werken in computer vision bij het creëren van adversarial voorbeelden waardoor auto’s een stopbord verkeerd interpreteren.

Hoe Prompt Hacking-aanvallen te Voorkomen

AI-systemen beschermen tegen prompt hacking vereist defense-in-depth in plaats van één enkele oplossing. Hier zijn zes beschermende maatregelen die samen een robuust schild vormen:

1. Valideer en Sanitize Invoer

Voordat een prompt uw model bereikt, laat u deze door patroonherkenning lopen die klassieke override-zinnen en verdachte coderingen identificeert. Implementeer regex-controles voor bekende aanvalspatronen en detecteer Unicode-homoglyfen die aanvallers gebruiken om detectie te omzeilen.

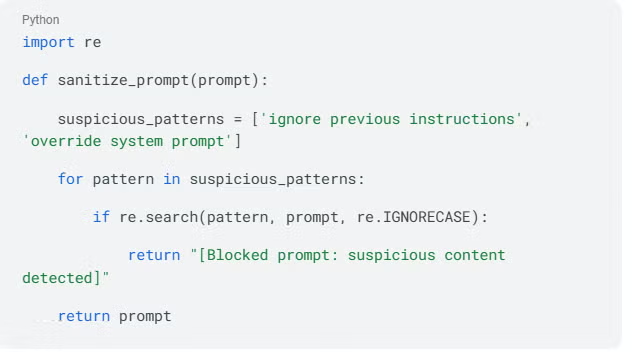

Hier is een eenvoudige Python-functie die basis patroon-gebaseerde promptfiltering implementeert om veelvoorkomende aanvalszinnen te onderscheppen:

Adversarial training met kwaadaardige voorbeelden kan uw filters versterken terwijl het aantal false positives laag blijft.

Adversarial training met kwaadaardige voorbeelden kan uw filters versterken terwijl het aantal false positives laag blijft.

2. Parameteriseer Systeeminstructies

Scheid gebruikersinvoer duidelijk van systeeminstructies met expliciete delimiters. Plaats gebruikersinvoer tussen markeringen (bijv. <|user|>{input}<|end|>) om te voorkomen dat het model onbetrouwbare inhoud verwart met bevoorrechte opdrachten.

Defensieve distillatie-technieken kunnen machine learning-modellen helpen bestand te zijn tegen manipulatie van invoergegevens.

3. Filter en Post-Process Outputs

Laat elk modelantwoord door meerdere veiligheidslagen gaan voordat het wordt afgeleverd. Implementeer toxiciteitsclassificaties en beleidsengines die inhoud kunnen weigeren die niet aan de normen voldoet. Voeg stateful controles toe die monitoren op "guardrail probing" waarbij white box-aanvallers geleidelijk privileges verhogen.

4. Isoleer LLM-omgevingen

Host taalmodellen in aparte containers, volledig gescheiden van kerngegevensopslag. Leid alle API-calls via streng afgebakende proxies die toegang tot externe bronnen beperken. Deze containment zorgt ervoor dat zelfs als een aanvaller het model manipuleert om een shell-commando of data-exfiltratie te proberen, de sandbox uitvoering voorkomt.

5. Implementeer Least Privilege Controls

Geef LLM’s alleen minimale rechten—alleen-lezen toegang tot kennisbanken en geen administratieve permissies. Gebruik kortlevende API-sleutels en fijnmazige RBAC om te voorkomen dat geslaagde prompt-aanvallen kunnen escaleren naar systemen met hogere waarde.

6. Monitor Continu op Anomalieën

Behandel elke LLM-interactie als een beveiligingsevent door prompts en antwoorden op te slaan in onveranderlijke opslag. Voer deze telemetrie in uw bestaande security monitoring-systemen in om ongebruikelijke patronen te identificeren. Het SentinelOne Singularity Platform is hiervan een voorbeeld door detectie te automatiseren en het aantal meldingen met 88% te verminderen.

Singularity™-platform

Verhoog uw beveiliging met realtime detectie, reactiesnelheid en volledig overzicht van uw gehele digitale omgeving.

Vraag een demo aanDetectie- en Herstelstrategieën

Sla prompts, gebruikers-ID’s, tijdstempels en modelantwoorden op in beveiligde opslag om sessies te kunnen herhalen en te traceren hoe kwaadaardige instructies zijn doorgedrongen. Voer logs in uw SIEM in en implementeer regels die aanvalssignaturen zichtbaar maken:

- Obfusceerde payloads: Grote Base64-strings duiden vaak op pogingen om verborgen instructies te smokkelen

- Context-overschrijvingen: Zinnen als "negeer alle eerdere instructies"

- Anomalie in volume: Plotselinge pieken in inzendingen vanaf één API-sleutel

Wanneer een aanval wordt bevestigd, isoleer gecompromitteerde componenten, trek blootgestelde API-sleutels in en schakel downstream connectors uit. Verwijder geïnjecteerde context uit caches, patch kwetsbare systeem-prompts en verfijn filters om ontdekte payload-varianten te blokkeren. Documenteer elke stap in een incidentrapportagesjabloon.

Incident Response & Recovery Playbook

Zelfs met robuuste verdediging kan een vastberaden aanvaller toch door uw vangrails heen breken. In dat geval heeft u een draaiboek nodig dat net zo snel werkt als de exploit.

- Begin met identificatie door de kwaadaardige prompt zichtbaar te maken. Continue logging van elk verzoek en antwoord stelt u in staat de exacte instructieketen te traceren die het model heeft gevolgd. Patroonherkenning van kenmerkende zinnen zoals "negeer eerdere instructies" of base64-blobs helpt verdachte activiteiten vrijwel realtime te signaleren.

- Bevestigt u een aanval, ga dan over tot containment door de gecompromitteerde componenten te isoleren. Start nieuwe sandbox-instanties, trek API-sleutels in die mogelijk zijn blootgesteld en beperk de gebruikerssessie. Als uw LLM is ingebed in een agent-workflow, schakel downstream connectors uit totdat u kunt verifiëren dat deze niet zijn gemanipuleerd.

- Voer vervolgens eradicatie uit door geïnjecteerde context uit caches of "geheugen"-functies te verwijderen, kwetsbare systeem-prompts te patchen en filters te verfijnen om ontdekte payload-varianten te blokkeren. Algemene cybersecurity-praktijken adviseren het bijwerken van instructiesjablonen na een incident als onderdeel van defense-in-depth, wat het risico op herhaalde exploits kan verkleinen.

- Tot slot, sluit af met lessons learned via een multidisciplinaire evaluatie en een rollback-test met security engineers, machine learning-specialisten en compliance-verantwoordelijken. Experts adviseren een "human in the loop" te houden om modelgedrag na het incident te beoordelen en herstelde prompts goed te keuren.

Documenteer elke stap in een incidentrapportagesjabloon waarin de kwaadaardige prompt, impactscope, tijdlijn en herstelmaatregelen worden vastgelegd. Securityteams combineren de evaluatie vaak met deze tests om te waarborgen dat de infrastructuur direct kan worden teruggedraaid als een prompt opnieuw destructieve wijzigingen veroorzaakt.

Voorkom Aanvallen Voordat Ze Beginnen

Prompt hacking verandert conversatie-interfaces in aanvalsvectoren die traditionele beveiliging omzeilen. Net zoals computer vision-systemen kunnen worden misleid om een stopbord verkeerd te classificeren, kunnen taalmodellen worden gemanipuleerd via zorgvuldig samengestelde invoer.

Verdediging vereist meerdere benaderingen: inputvalidatie, outputfiltering, omgevingsisolatie, continue monitoring en adversarial training. Snel te implementeren maatregelen zoals geparameteriseerde prompts verhogen direct de drempel, terwijl diepgaandere investeringen in sandboxing veerkrachtige systemen creëren.

Behandel promptbeveiliging als een doorlopende discipline, niet als een eenmalige implementatie. Aanvallers itereren snel en ontwikkelen nieuwe technieken om detectie te ontwijken. Organisaties die security reviews integreren in AI-ontwikkeltrajecten blijven voor op tegenstanders die elk gesprek als een potentiële compromittering zien.

De hier beschreven kaders bieden u de basis om bescherming op te bouwen voordat de volgende slim geformuleerde zin uw verdediging ondermijnt.

Veelgestelde vragen over Prompt Hacking

U verdedigt zich tegen linguïstische manipulatie, niet tegen kwaadaardige code. Aanvallers maken misbruik van de neiging van het LLM om elke tekst als even gezaghebbend te behandelen.

Ja. Private modellen hebben dezelfde kwetsbaarheden. Een insider of gecompromitteerde gegevensbron kan verborgen instructies injecteren die het model zonder vragen opvolgt.

Prompt-gebaseerde data-exfiltratie veroorzaakt dezelfde compliance-risico's als elk ander datalek. Eén gelekte prompt kan leiden tot GDPR-, HIPAA- of vergelijkbare sancties.

Controleer filters, logs en systeem-prompts minimaal maandelijks of na elke modelupdate. Dreigingsactoren itereren snel en AI-ondersteunde aanvallen versnellen voortdurend.

Technische geletterdheid, cross-modale dreigingsanalyse en continue red-teaming vormen kerncompetenties voor AI-beveiligingsrollen.