AIは私たちの日常生活で利用されています。LLMが仕事や学校の課題、買い物の手助け、税金の計算、あるいはパーソナルアシスタントとしてあらゆる分野を席巻する中で、大量の情報がオンラインで保存・送信されています。プロンプトハッカーは、LLMが設計上安全でもセキュアでもないことを理解しています。

そして、これが彼らにとって機密情報を乗っ取る絶好の機会となります。AIを誤った方向に誘導し、意図せず秘密を漏らすのに必要なのは、たった1つのプロンプトだけです。本ガイドでは、プロンプトハッキングとは何かを解説します。仕組みや防御方法などについて、以下でご紹介します。

.png)

プロンプトハッキングとは?

プロンプトハッキングとは、セキュリティ制御を上書きしたり、意図しない応答を引き出すために、慎重に作成された入力を用いてAI言語モデルを意図的に操作する行為です。これらの回避攻撃は、大規模言語モデル(LLM)が自然言語処理において正当な指示と悪意のあるコマンドを区別できないことを悪用し、モデルがすべてのテキストを同等の権威として扱う傾向を利用します。

攻撃者は、カスタマーサポートチャットボット、コンテンツアナライザー、AIが取り込む侵害されたサードパーティデータフィードなど、複数のエントリーポイントからアクセスを得ます。プロンプトインジェクション攻撃は訓練済みモデルに理論的なリスクをもたらしますが、最新のチャットボットはシステムレベルのセキュリティを上書きする埋め込み指示を防ぐガードレールを実装できます。

攻撃が成功すると、専有システムの侵害、機密データの漏洩、接続されたアプリケーションを通じた不正な操作、安全制御が回避された場合の重大な評判リスクなどが発生します。

プロンプトハッキング攻撃が問題となる理由

プロンプトハッキングは、AIが入力データを本質的に信頼する性質を悪用し、従来のセキュリティ防御を回避して、従来のツールでは保護できない全く新しい攻撃対象領域を生み出します。コードベースの脆弱性とは異なり、これらの敵対的機械学習攻撃は、深層ニューラルネットワークを意味論レベルで操作します:

- ビジネスへの影響:攻撃はAIが言語を処理する場所で発生し、ファイアウォールを回避して専有の訓練データを露出させたり、不正な操作を引き起こしたりしますが、従来のシグネチャは残しません。

- 攻撃対象領域の拡大:AIの導入ごとに新たなエントリーポイントが生まれ、特にシステムがバックエンドインフラに接続されている場合に顕著です。

- 検知の難しさ:悪意のあるプロンプトは正当なリクエストと混在し、パターンマッチングによる検知は、認識しやすいSQLシグネチャと比べて不十分です。

- 手法の進化:「以前の指示をすべて無視する」といった単純なコマンドから、高度なポイズニング攻撃まで、新たな脱獄手法が毎週のように登場しています。

- コンプライアンス違反:AIシステムが規制対象データを処理する場合、プロンプト攻撃はGDPRやHIPAA上のデータ侵害となる可能性があります。

この新たな脅威に対処するには、セキュリティチームが従来のサイバーセキュリティと機械学習モデルに対する敵対的攻撃防御の両方に精通する必要があります。

プロンプトハッキング攻撃の4つのカテゴリ

リアルタイムのアラートトリアージには迅速な判断が求められます。以下のマトリクスは、プロンプトハッキングが該当する敵対的攻撃のカテゴリを示しています:

| 攻撃タイプ | 目的 | 手法 | 検知シグナル |

| ゴールハイジャック | 意図されたタスクフローの上書き | 「以前の指示をすべて無視して...」 | 突然のコンテキスト変更、上書きフレーズ |

| ガードレールバイパス | 安全フィルタの回避 | ロールプレイによる脱獄(「フィルタなしアシスタントとして振る舞う」) | 無害なクエリ後の禁止コンテンツ |

| 情報漏洩 | システムプロンプトや機密データの抽出 | 内部指示を要求するクエリチェーン | 構成や秘密情報を反映した応答 |

| インフラ攻撃 | 接続システムの操作 | シェルコマンドを誘発する間接的インジェクション | 予期しないAPIコールやファイルアクセス |

これらのカテゴリはしばしば混在します。たとえば、攻撃が秘密情報を抽出し、その後APIコールを発生させて本番システムを侵害する場合があります。これは、ブラックボックス攻撃がコンピュータビジョンで敵対的サンプルを作成し、自動運転車が停止標識を誤認識する仕組みに似ています。

プロンプトハッキング攻撃の防止方法

AIシステムの保護には、多層防御が必要であり、単一のソリューションでは不十分です。堅牢な防御を構成する6つの対策を紹介します:

1. 入力の検証とサニタイズ

プロンプトがモデルに到達する前に、典型的な上書きフレーズや不審なエンコーディングを識別するパターン検出を実施します。既知の攻撃パターンに対する正規表現チェックや、攻撃者が検知回避に用いるUnicodeホモグリフの検出を実装してください。

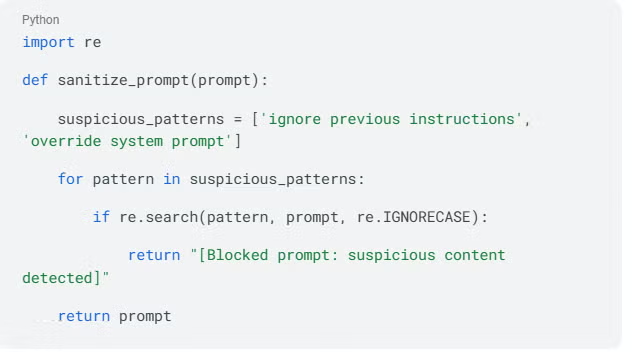

以下は、一般的な攻撃フレーズを検出する基本的なパターンベースのプロンプトフィルタリングを実装したシンプルなPython関数です:

悪意のあるサンプルを用いた敵対的訓練により、誤検知率を低く保ちながらフィルタを強化できます。

悪意のあるサンプルを用いた敵対的訓練により、誤検知率を低く保ちながらフィルタを強化できます。

2. システム指示のパラメータ化

ユーザーテキストとシステム指示を明確に区別するため、明示的なデリミタを使用します。ユーザー入力を(例:<|user|>{input}<|end|>)のようなマーカーで囲み、モデルが信頼できない内容を特権コマンドと混同しないようにします。

防御的蒸留技術は、機械学習モデルが入力データの操作に耐性を持つのに役立ちます。

3. 出力のフィルタリングと後処理

すべてのモデル応答を配信前に複数の安全レイヤで検査します。有害性分類器やポリシーエンジンを実装し、基準に違反するコンテンツを拒否できるようにします。ホワイトボックス攻撃者が段階的に権限を昇格させる「ガードレールプロービング」を監視するステートフルチェックを追加してください。

4. LLM環境の分離

言語モデルを専用コンテナでホストし、コアデータストアから完全に分離します。すべてのAPIコールを厳格にスコープされたプロキシ経由でルーティングし、外部リソースへのアクセスを制限します。このコンテナ化により、攻撃者がモデルを操作してシェルコマンドやデータ流出を試みても、サンドボックスが実行を防ぎます。

5. 最小権限制御の実装

LLMには最小限の認証情報のみを付与し、ナレッジベースへの読み取り専用アクセスとし、管理権限は与えません。短期間有効なAPIキーやきめ細かなRBACを利用し、プロンプト攻撃が高価値システムへの権限昇格につながらないようにします。

6. 継続的な異常監視

すべてのLLMインタラクションをセキュリティイベントとして扱い、プロンプトと応答を不変ストレージに記録します。このテレメトリを既存のセキュリティ監視システムに取り込み、異常パターンを特定します。SentinelOne Singularity Platformは、このアプローチを自動化し、アラート件数を88%削減する例です。

検知と復旧の戦略

プロンプト、ユーザー識別子、タイムスタンプ、モデル応答を安全なストレージに保存し、セッションを再現して悪意のある指示がどのようにすり抜けたかを追跡します。ログをSIEMに取り込み、攻撃シグネチャを検出するルールを展開します:

- 難読化されたペイロード: 大きなBase64文字列は、隠された指示を持ち込もうとする試みの兆候であることが多い

- コンテキストの上書き: 「以前の指示をすべて無視して」などのフレーズ

- 異常なボリューム: 単一のAPIキーからの提出が急増

攻撃が確認された場合、侵害されたコンポーネントを隔離し、漏洩したAPIキーを無効化し、下流コネクタを停止します。キャッシュから注入されたコンテキストを消去し、脆弱なシステムプロンプトを修正し、発見されたペイロードのバリアントをブロックするようフィルタを微調整します。すべての手順をインシデントレポートテンプレートに記録してください。

インシデント対応&復旧プレイブック

堅牢な防御を施していても、執拗な攻撃者がガードレールを突破する可能性は残ります。その際は、攻撃と同じスピードで動くプレイブックが必要です。

- まず、悪意のあるプロンプトを特定することから始めます。 すべてのリクエストと応答を継続的に記録することで、モデルがたどった指示チェーンを正確に追跡できます。「以前の指示を無視」やbase64ブロブなどの特徴的な文字列をパターンマッチングすることで、ほぼリアルタイムで不審な活動を検出できます。

- 攻撃を確認したら、侵害されたコンポーネントを隔離して封じ込めに移行します。新しいサンドボックスインスタンスを立ち上げ、プロンプトで漏洩した可能性のあるAPIキーを無効化し、ユーザーセッションを制限します。LLMがエージェントワークフローに組み込まれている場合は、下流コネクタを一時的に無効化し、操作されていないことを確認します。

- 次に、根絶を実行し、キャッシュや「メモリ」機能から注入されたコンテキストを消去し、脆弱なシステムプロンプトを修正し、発見されたペイロードバリアントをブロックするようフィルタを微調整します。一般的なサイバーセキュリティのベストプラクティスとして、侵害後に指示テンプレートを更新することが多層防御の一環となり、再発リスクの低減に役立ちます。

- 最後に、クロスファンクショナルな振り返りとロールバックテストによる教訓の整理を行い、セキュリティエンジニア、機械学習スペシャリスト、コンプライアンス担当者が参加します。業界専門家は、インシデント後のモデル挙動を「人間が介在」してレビューし、復元されたプロンプトを承認することを推奨しています。

悪意のあるプロンプト、影響範囲、タイムライン、是正措置を記録するインシデントレポートテンプレートに、すべての手順を文書化してください。セキュリティチームは、これらのテストと振り返りを組み合わせて、プロンプトが再び破壊的な変更を引き起こした場合でも、インフラを即座にロールバックできることを確認します。

攻撃を未然に防ぐ

プロンプトハッキングは、会話型インターフェースを従来のセキュリティを回避する攻撃ベクトルに変えます。コンピュータビジョンシステムが停止標識を誤認識させられるのと同様に、言語モデルも巧妙に作成された入力によって操作される可能性があります。

防御には、入力検証、出力フィルタリング、環境分離、継続的監視、敵対的訓練など複数のアプローチが必要です。パラメータ化されたプロンプトのような即効性のある対策は即座に防御力を高め、サンドボックス化への投資はレジリエントなシステムを構築します。

プロンプトセキュリティは一度きりの実装ではなく、継続的な取り組みとして捉えてください。攻撃者は検知回避の新手法を次々と生み出します。AI開発ライフサイクルにセキュリティレビューを組み込む組織は、あらゆる会話を潜在的な侵害とみなす攻撃者よりも一歩先を行くことができます。

ここで紹介したフレームワークは、巧妙に作成された次の一文が防御を突破する前に、保護を構築するための基盤となります。

プロンプトハッキングに関するFAQ

防御対象は悪意のあるコードではなく、言語的な操作です。攻撃者はLLMがすべてのテキストを同等に権威あるものとして扱う傾向を悪用します。

はい。プライベートモデルも同様の脆弱性を抱えています。内部関係者や侵害されたデータソースが、モデルが無条件に従う隠れた指示を注入する可能性があります。

プロンプトを利用したデータ流出は、他の侵害と同様のコンプライアンス上の責任を生じさせます。1件のプロンプト漏洩でもGDPRやHIPAAなどの制裁が発生する可能性があります。

フィルタ、ログ、システムプロンプトは少なくとも月次、またはモデル更新後に見直してください。脅威アクターは迅速に手法を進化させており、AI支援型攻撃も常に加速しています。

エンジニアリングリテラシー、クロスモーダル脅威分析、継続的なレッドチーミングがAIセキュリティ職の中核的な能力となります。