L’IA est utilisée dans notre vie quotidienne. Avec les LLM qui dominent tous les domaines, du travail aux devoirs scolaires, en passant par l’aide aux courses, le calcul des impôts ou l’assistance personnelle, elle stocke et transmet de nombreuses informations en ligne. Les hackers spécialisés dans les prompts savent que les LLM ne sont pas sûrs ou sécurisés par conception.

Et c’est pour eux l’occasion de tirer parti de toutes ces informations sensibles en détournant leur usage. Un seul prompt suffit à orienter l’IA dans la mauvaise direction et à divulguer accidentellement vos secrets. Dans ce guide, nous allons explorer ce qu’est le prompt hacking. Vous découvrirez comment il fonctionne, comment s’en protéger, et plus encore ci-dessous.

.png)

Qu’est-ce que le Prompt Hacking ?

Le prompt hacking est la manipulation délibérée de modèles de langage IA via des entrées soigneusement conçues pour contourner les contrôles de sécurité ou extraire des réponses non prévues. Ces attaques d’évasion exploitent l’incapacité des grands modèles de langage (LLM) à distinguer les instructions légitimes des commandes malveillantes dans le traitement du langage naturel, profitant de la tendance du modèle à traiter tout texte avec la même autorité.

Les attaquants accèdent au système via de multiples points d’entrée, tels que les chatbots de support client, les analyseurs de contenu ou des flux de données tiers compromis que votre IA consomme. Bien que les attaques par injection de prompt représentent des risques théoriques pour les modèles entraînés, les chatbots modernes peuvent mettre en œuvre des garde-fous pour empêcher les instructions intégrées de remplacer la sécurité au niveau système.

Les attaques réussies peuvent entraîner la compromission de systèmes propriétaires, l’exposition de données sensibles, des actions non autorisées via des applications connectées, et des dommages réputationnels importants lorsque les contrôles de sécurité sont contournés.

Pourquoi les attaques de Prompt Hacking posent problème

Le prompt hacking contourne les défenses de sécurité traditionnelles en exploitant la confiance inhérente de l’IA dans les données d’entrée, créant une toute nouvelle surface d’attaque que les outils conventionnels ne peuvent pas protéger. Contrairement aux vulnérabilités basées sur le code, ces attaques adversariales sur l’apprentissage automatique manipulent les réseaux neuronaux profonds au niveau sémantique :

- Impact métier : Les attaques opèrent là où l’IA traite le langage, contournant les pare-feux pour exposer des données d’entraînement propriétaires ou déclencher des actions non autorisées sans laisser de traces conventionnelles.

- Surface d’attaque en expansion : Chaque déploiement d’IA crée de nouveaux points d’entrée, en particulier lorsque les systèmes sont connectés à l’infrastructure backend.

- Défis de détection : Les prompts malveillants se fondent dans les requêtes légitimes, rendant la détection par correspondance de motifs inadéquate par rapport aux signatures SQL reconnaissables.

- Techniques en évolution : Des simples commandes « ignorer les instructions précédentes » aux attaques de poisoning sophistiquées, de nouvelles méthodes de jailbreak apparaissent chaque semaine.

- Violations de conformité : Lorsque les systèmes IA traitent des données réglementées, les attaques par prompt peuvent constituer une violation de données au regard du RGPD ou de l’HIPAA.

Cette menace émergente exige que les équipes de sécurité développent une expertise couvrant à la fois la cybersécurité traditionnelle et la défense contre les attaques adversariales sur les modèles d’apprentissage automatique.

4 catégories d’attaques de Prompt Hacking

Le tri des alertes en temps réel exige des décisions rapides. Ce tableau présente les différents types de catégories d’attaques adversariales auxquelles le prompt hacking peut appartenir :

| Type d’attaque | Objectif | Technique | Signaux de détection |

| Détournement d’objectif | Outrepasser le flux de tâches prévu | « Ignore toutes les instructions précédentes et... » | Changements soudains de contexte, phrases de contournement |

| Contournement des garde-fous | Éviter les filtres de sécurité | Jailbreak par jeu de rôle (« Agis comme un assistant sans filtre ») | Contenu interdit après des requêtes bénignes |

| Fuite d’informations | Extraire des prompts système ou des données sensibles | Chaînes de requêtes demandant des instructions internes | Réponses reflétant la configuration ou des secrets |

| Attaque sur l’infrastructure | Manipuler des systèmes connectés | Injection indirecte déclenchant des commandes shell | Appels API ou accès fichiers inattendus |

Ces catégories se recoupent souvent. Par exemple, une attaque peut extraire des secrets, puis déclencher des appels API compromettant des systèmes de production, à l’image de la façon dont fonctionnent les attaques black box en vision par ordinateur lors de la création d’exemples adversariaux qui font mal interpréter un panneau stop à une voiture autonome.

Comment prévenir les attaques de Prompt Hacking

Protéger les systèmes IA contre le prompt hacking nécessite une défense en profondeur plutôt qu’une solution unique. Voici six mesures de protection qui constituent un bouclier robuste :

1. Valider et assainir les entrées

Avant qu’un prompt n’atteigne votre modèle, faites-le passer par une détection de motifs identifiant les phrases classiques de contournement et les encodages suspects. Mettez en œuvre des vérifications regex pour les schémas d’attaque connus tout en détectant les homoglyphes Unicode utilisés par les attaquants pour échapper à la détection.

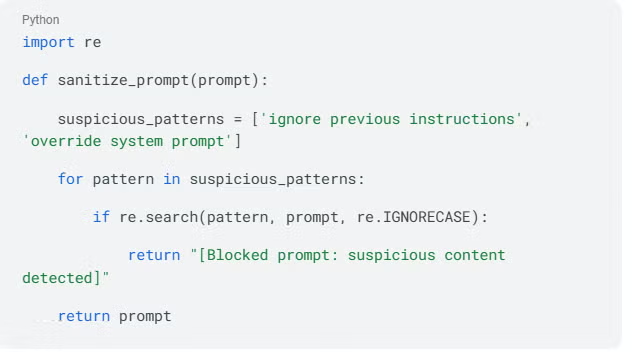

Voici une fonction Python simple qui implémente un filtrage de prompt basé sur des motifs pour détecter les phrases d’attaque courantes :

L’entraînement adversarial avec des exemples malveillants peut renforcer vos filtres tout en maintenant un faible taux de faux positifs.

L’entraînement adversarial avec des exemples malveillants peut renforcer vos filtres tout en maintenant un faible taux de faux positifs.

2. Paramétrer les instructions système

Séparez clairement le texte utilisateur des instructions système à l’aide de délimiteurs explicites. Encadrez les entrées utilisateur dans des marqueurs (par exemple, <|user|>{input}<|end|>) pour éviter que le modèle ne confonde du contenu non fiable avec des commandes privilégiées.

Les techniques de distillation défensive peuvent aider les modèles d’apprentissage automatique à résister à la manipulation des données d’entrée.

3. Filtrer et post-traiter les sorties

Faites passer chaque réponse du modèle par plusieurs couches de sécurité avant livraison. Mettez en œuvre des classificateurs de toxicité et des moteurs de politique capables de refuser le contenu violant les standards. Ajoutez des contrôles avec état qui surveillent les « tests de garde-fous » où les attaquants white box augmentent progressivement leurs privilèges.

4. Isoler les environnements LLM

Hébergez les modèles de langage dans des conteneurs dédiés, totalement séparés des bases de données principales. Faites transiter tous les appels API par des proxys à périmètre restreint qui limitent l’accès aux ressources externes. Ce confinement garantit que même si un attaquant manipule le modèle pour tenter une commande shell ou une exfiltration de données, le bac à sable empêche l’exécution.

5. Mettre en œuvre le principe du moindre privilège

N’accordez aux LLM que des droits minimaux : accès en lecture seule aux bases de connaissances et aucune permission administrative. Utilisez des clés API à durée de vie courte et un RBAC granulaire pour garantir qu’une attaque par prompt ne puisse pas s’étendre à des systèmes à forte valeur.

6. Surveiller en continu les anomalies

Considérez chaque interaction LLM comme un événement de sécurité en journalisant prompts et réponses dans un stockage immuable. Intégrez cette télémétrie à vos systèmes de supervision de la sécurité existants pour identifier les schémas inhabituels. La plateforme SentinelOne Singularity illustre cette approche en automatisant la détection et en réduisant le volume d’alertes de 88 %.

Plate-forme Singularity™

Améliorez votre posture de sécurité grâce à la détection en temps réel, à une réponse à la vitesse de la machine et à une visibilité totale de l'ensemble de votre environnement numérique.

Obtenir une démonstrationStratégies de détection et de remédiation

Stockez les prompts, identifiants utilisateurs, horodatages et réponses du modèle dans un stockage sécurisé pour rejouer les sessions et retracer comment des instructions malveillantes ont pu passer. Intégrez les journaux à votre SIEM et déployez des règles qui font remonter les signatures d’attaque :

- Payloads obfusqués : De longues chaînes Base64 signalent souvent des tentatives de dissimulation d’instructions cachées

- Contournement de contexte : Phrases telles que « ignore toutes les instructions précédentes »

- Volume anormal : Pics soudains de soumissions depuis une même clé API

Lorsqu’une attaque est confirmée, isolez les composants compromis, révoquez les clés API exposées et désactivez les connecteurs en aval. Purgez tout contexte injecté des caches, corrigez les prompts système vulnérables et affinez les filtres pour bloquer les variantes de payload découvertes. Documentez chaque étape dans un modèle de rapport d’incident.

Playbook de réponse et de remédiation aux incidents

Même avec des défenses robustes, un attaquant déterminé peut encore franchir vos garde-fous. Dans ce cas, il vous faut un playbook aussi rapide que l’exploit.

- Commencez par l’identification en faisant remonter le prompt malveillant. La journalisation continue de chaque requête et réponse vous permet de retracer la chaîne exacte d’instructions suivie par le modèle. La recherche de motifs pour des chaînes caractéristiques comme « ignore les instructions précédentes » ou des blobs base64 vous aide à signaler une activité suspecte quasi en temps réel.

- Une fois l’attaque confirmée, passez au confinement en isolant les composants compromis. Lancez de nouvelles instances sandbox, révoquez les clés API que le prompt a pu exposer et limitez la session utilisateur. Si votre LLM est intégré à un workflow d’agent, désactivez les connecteurs en aval jusqu’à vérification de leur intégrité.

- Ensuite, procédez à l’éradication en purgeant tout contexte injecté des caches ou fonctionnalités de « mémorisation », en corrigeant les prompts système vulnérables et en affinant les filtres pour bloquer les variantes de payload découvertes. Les bonnes pratiques recommandent de mettre à jour les modèles d’instructions après une compromission dans le cadre d’une défense en profondeur, ce qui peut réduire le risque de ré-exploitation.

- Enfin, terminez par un retour d’expérience via un debrief transversal et un test de rollback impliquant ingénieurs sécurité, spécialistes machine learning et responsables conformité. Les experts recommandent de garder un « humain dans la boucle » pour examiner le comportement du modèle après incident et valider la restauration des prompts.

Documentez chaque étape dans un modèle de rapport d’incident incluant le prompt malveillant, l’étendue de l’impact, la chronologie et les actions correctives. Les équipes sécurité associent fréquemment le debrief à ces tests pour garantir que l’infrastructure puisse être restaurée instantanément si un prompt devait à nouveau déclencher des changements destructeurs.

Stopper les attaques avant qu’elles ne commencent

Le prompt hacking transforme les interfaces conversationnelles en vecteurs d’attaque contournant la sécurité traditionnelle. De la même manière que les systèmes de vision par ordinateur peuvent être trompés pour mal classer un panneau stop, les modèles de langage peuvent être manipulés via des entrées soigneusement élaborées.

La défense nécessite des approches multiples : validation des entrées, filtrage des sorties, isolation des environnements, surveillance continue et entraînement adversarial. Des mesures rapides comme la paramétrisation des prompts élèvent immédiatement le niveau, tandis que des investissements plus profonds dans le sandboxing créent des systèmes résilients.

Considérez la sécurité des prompts comme une discipline continue, et non une implémentation ponctuelle. Les attaquants itèrent rapidement, créant de nouvelles techniques pour échapper à la détection. Les organisations qui intègrent les revues de sécurité dans le cycle de développement IA garderont une longueur d’avance sur les adversaires qui voient chaque conversation comme une compromission potentielle.

Les cadres présentés ici vous donnent les bases pour bâtir une protection avant que la prochaine phrase habilement conçue ne fasse tomber vos défenses.

FAQ sur le Prompt Hacking

Vous vous défendez contre la manipulation linguistique, et non contre du code malveillant. Les attaquants exploitent la tendance du LLM à considérer chaque texte comme également autoritaire.

Oui. Les modèles privés présentent les mêmes vulnérabilités. Un initié ou une source de données compromise peut injecter des instructions cachées que le modèle suivra sans remise en question.

L’exfiltration de données basée sur les prompts entraîne les mêmes responsabilités de conformité que toute autre violation. Un seul prompt divulgué peut déclencher des sanctions RGPD, HIPAA ou similaires.

Examinez les filtres, journaux et prompts système au moins une fois par mois ou après toute mise à jour du modèle. Les acteurs malveillants itèrent rapidement et les attaques assistées par IA s’accélèrent constamment.

La maîtrise de l’ingénierie, l’analyse des menaces intermodales et le red teaming continu constituent des compétences clés pour les rôles de sécurité IA.