KI wird in unserem Alltag eingesetzt. Mit LLMs, die in allen Bereichen dominieren – von der Arbeit, über Hausaufgaben, Unterstützung beim Lebensmitteleinkauf, Steuerberechnung bis hin zum persönlichen Assistenten – werden viele Informationen online gespeichert und übertragen. Prompt-Hacker wissen, dass LLMs nicht von Haus aus sicher oder geschützt sind.

Und das ist ihre Chance, sich einen Vorteil zu verschaffen, indem sie all diese sensiblen Informationen kapern. Ein einziger Prompt reicht aus, um KI in die falsche Richtung zu lenken und versehentlich Ihre Geheimnisse preiszugeben. In diesem Leitfaden erläutern wir, was Prompt-Hacking ist. Sie erfahren, wie es funktioniert, wie Sie sich dagegen schützen können und mehr.

.png)

Was ist Prompt-Hacking?

Prompt-Hacking ist die gezielte Manipulation von KI-Sprachmodellen durch sorgfältig gestaltete Eingaben, die darauf abzielen, Sicherheitskontrollen zu umgehen oder unbeabsichtigte Antworten zu extrahieren. Diese Umgehungsangriffe nutzen die Unfähigkeit von Large Language Models (LLMs) aus, zwischen legitimen Anweisungen und bösartigen Befehlen in der Verarbeitung natürlicher Sprache zu unterscheiden, und machen sich die Tendenz des Modells zunutze, allen Texten die gleiche Autorität beizumessen.

Angreifer verschaffen sich Zugang über verschiedene Einstiegspunkte, wie z. B. Kundensupport-Chatbots, Inhaltsanalysatoren oder kompromittierte Drittanbieter-Datenfeeds, die Ihre KI verarbeitet. Während Prompt-Injection-Angriffe theoretische Risiken für trainierte Modelle darstellen, können moderne Chatbots Schutzmechanismen implementieren, um zu verhindern, dass eingebettete Anweisungen systemweite Sicherheitskontrollen überschreiben.

Erfolgreiche Angriffe können zu kompromittierten proprietären Systemen, offengelegten sensiblen Daten, unautorisierten Aktionen über verbundene Anwendungen und erheblichen Reputationsschäden führen, wenn Sicherheitskontrollen umgangen werden.

Warum Prompt-Hacking-Angriffe ein Problem sind

Prompt-Hacking umgeht traditionelle Sicherheitsmaßnahmen, indem es das grundlegende Vertrauen der KI in Eingabedaten ausnutzt und so eine völlig neue Angriffsfläche schafft, die mit herkömmlichen Tools nicht geschützt werden kann. Im Gegensatz zu codebasierten Schwachstellen manipulieren diese adversarialen Machine-Learning-Angriffe tiefe neuronale Netze auf semantischer Ebene:

- Geschäftliche Auswirkungen: Angriffe erfolgen dort, wo KI Sprache verarbeitet, umgehen Firewalls, legen proprietäre Trainingsdaten offen oder lösen unautorisierte Aktionen aus, ohne herkömmliche Signaturen zu hinterlassen.

- Wachsende Angriffsfläche: Jede KI-Implementierung schafft neue Einstiegspunkte, insbesondere wenn Systeme mit Backend-Infrastrukturen verbunden sind.

- Erkennungsprobleme: Bösartige Prompts vermischen sich mit legitimen Anfragen, wodurch Mustererkennung im Vergleich zu erkennbaren SQL-Signaturen unzureichend ist.

- Entwicklung der Techniken: Von einfachen Befehlen wie „Ignoriere vorherige Anweisungen“ bis hin zu ausgefeilten Poisoning-Angriffen entstehen wöchentlich neue Jailbreak-Methoden.

- Compliance-Verstöße: Wenn KI-Systeme regulierte Daten verarbeiten, können Prompt-Angriffe einen Datenschutzverstoß nach DSGVO oder HIPAA darstellen.

Diese neue Bedrohung erfordert, dass Sicherheitsteams sowohl über klassische Cybersecurity-Expertise als auch über Verteidigungsmaßnahmen gegen adversariale Angriffe auf Machine-Learning-Modelle verfügen.

4 Kategorien von Prompt-Hacking-Angriffen

Echtzeit-Alarmtriage erfordert schnelle Entscheidungen. Diese Matrix zeigt die verschiedenen Arten adversarialer Angriffskategorien, unter die Prompt-Hacking fallen kann:

| Angriffsart | Ziel | Technik | Erkennungssignale |

| Zielübernahme | Vorgesehenen Aufgabenfluss überschreiben | „Ignoriere alle vorherigen Anweisungen und...“ | Plötzliche Kontextwechsel, Überschreibungsphrasen |

| Guardrail-Umgehung | Sicherheitsfilter umgehen | Rollenspiel-Jailbreaks („Agieren Sie als ungefilterter Assistent“) | Verbotene Inhalte nach harmlosen Anfragen |

| Informationsleckage | Systemprompts oder sensible Daten extrahieren | Abfrageketten, die interne Anweisungen anfordern | Antworten, die Konfigurationen oder Geheimnisse wiedergeben |

| Infrastrukturangriff | Verbundene Systeme manipulieren | Indirekte Injection, die Shell-Befehle auslöst | Unerwartete API-Aufrufe oder Dateizugriffe |

Diese Kategorien vermischen sich häufig. Beispielsweise kann ein Angriff zunächst Geheimnisse extrahieren und anschließend API-Aufrufe auslösen, die Produktionssysteme kompromittieren – ähnlich wie Black-Box-Angriffe im Bereich Computer Vision, bei denen adversariale Beispiele dazu führen, dass Autos ein Stoppschild falsch interpretieren.

Wie man Prompt-Hacking-Angriffe verhindert

Der Schutz von KI-Systemen vor Prompt-Hacking erfordert Defense-in-Depth statt einer Einzellösung. Hier sind sechs Schutzmaßnahmen, die einen robusten Schutzschild bilden:

1. Eingaben validieren und bereinigen

Bevor ein Prompt Ihr Modell erreicht, führen Sie eine Mustererkennung durch, die klassische Überschreibungsphrasen und verdächtige Codierungen identifiziert. Implementieren Sie Regex-Prüfungen für bekannte Angriffsmuster und erkennen Sie Unicode-Homoglyphen, die Angreifer zur Umgehung der Erkennung nutzen.

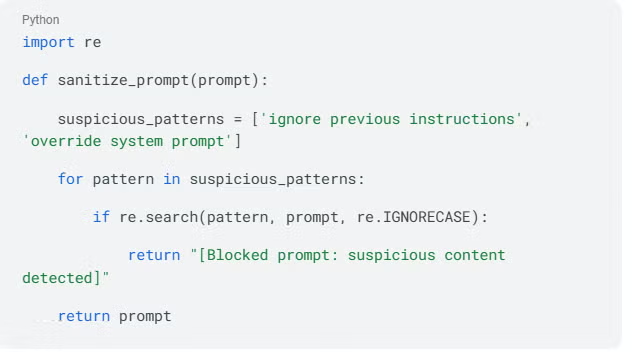

Hier ist eine einfache Python-Funktion, die eine grundlegende, musterbasierte Prompt-Filterung implementiert, um gängige Angriffsphrasen zu erkennen:

Adversariales Training mit bösartigen Beispielen kann Ihre Filter stärken und gleichzeitig die False-Positive-Rate niedrig halten.

Adversariales Training mit bösartigen Beispielen kann Ihre Filter stärken und gleichzeitig die False-Positive-Rate niedrig halten.

2. Systemanweisungen parametrisieren

Trennen Sie Benutzereingaben klar von Systemanweisungen durch explizite Trennzeichen. Umschließen Sie Benutzereingaben mit Markern (z. B. <|user|>{input}<|end|>), um zu verhindern, dass das Modell nicht vertrauenswürdige Inhalte mit privilegierten Befehlen verwechselt.

Defensive Distillation-Techniken können Machine-Learning-Modelle widerstandsfähiger gegen Manipulation von Eingabedaten machen.

3. Ausgaben filtern und nachbearbeiten

Überprüfen Sie jede Modellantwort vor der Auslieferung durch mehrere Sicherheitsschichten. Implementieren Sie Toxizitätsklassifizierer und Richtlinien-Engines, die Inhalte ablehnen können, die Standards verletzen. Fügen Sie zustandsbehaftete Prüfungen hinzu, die auf „Guardrail-Probing“ achten, bei dem White-Box-Angreifer schrittweise Privilegien erhöhen.

4. LLM-Umgebungen isolieren

Hosten Sie Sprachmodelle in dedizierten Containern, vollständig getrennt von zentralen Datenspeichern. Leiten Sie alle API-Aufrufe über streng begrenzte Proxys, die den Zugriff auf externe Ressourcen einschränken. Diese Abschottung stellt sicher, dass selbst wenn ein Angreifer das Modell zur Ausführung eines Shell-Befehls oder zur Datenexfiltration bringt, die Sandbox die Ausführung verhindert.

5. Least-Privilege-Kontrollen implementieren

Gewähren Sie LLMs nur minimale Berechtigungen – Lesezugriff auf Wissensdatenbanken und keine administrativen Rechte. Verwenden Sie kurzlebige API-Schlüssel und fein abgestufte RBAC, um sicherzustellen, dass erfolgreiche Prompt-Angriffe nicht auf höherwertige Systeme eskalieren können.

6. Kontinuierliche Anomalieüberwachung

Behandeln Sie jede LLM-Interaktion als Sicherheitsereignis, indem Sie Prompts und Antworten in unveränderlichem Speicher protokollieren. Leiten Sie diese Telemetrie in Ihre bestehenden Sicherheitsüberwachungssysteme ein, um ungewöhnliche Muster zu erkennen. Die SentinelOne Singularity Platform ist ein Beispiel für diesen Ansatz, indem sie die Erkennung automatisiert und das Alarmvolumen um 88 % reduziert.

Singularity™-Plattform

Verbessern Sie Ihre Sicherheitslage mit Echtzeit-Erkennung, maschineller Reaktion und vollständiger Transparenz Ihrer gesamten digitalen Umgebung.

Demo anfordernErkennungs- und Wiederherstellungsstrategien

Speichern Sie Prompts, Benutzerkennungen, Zeitstempel und Modellantworten in sicherem Speicher, um Sitzungen wiederzugeben und nachzuvollziehen, wie bösartige Anweisungen durchgerutscht sind. Leiten Sie Protokolle in Ihr SIEM und setzen Sie Regeln ein, die Angriffssignaturen sichtbar machen:

- Verschleierte Nutzlasten: Große Base64-Strings deuten oft auf Versuche hin, versteckte Anweisungen einzuschleusen

- Kontextüberschreibungen: Phrasen wie „ignoriere alle vorherigen Anweisungen“

- Anomales Volumen: Plötzliche Anstiege bei Einsendungen von einem einzelnen API-Schlüssel

Wenn ein Angriff bestätigt wird, isolieren Sie kompromittierte Komponenten, widerrufen Sie offengelegte API-Schlüssel und deaktivieren Sie nachgelagerte Konnektoren. Löschen Sie injizierten Kontext aus Caches, patchen Sie verwundbare Systemprompts und passen Sie Filter an, um entdeckte Payload-Varianten zu blockieren. Dokumentieren Sie jeden Schritt in einer Incident-Report-Vorlage.

Incident-Response- & Recovery-Playbook

Selbst mit robusten Schutzmaßnahmen kann ein entschlossener Angreifer Ihre Schutzmechanismen umgehen. In diesem Fall benötigen Sie ein Playbook, das so schnell agiert wie der Exploit.

- Beginnen Sie mit der Identifikation, indem Sie den bösartigen Prompt sichtbar machen. Durch kontinuierliches Logging jeder Anfrage und Antwort können Sie die genaue Befehlskette nachvollziehen, der das Modell gefolgt ist. Mustererkennung für typische Zeichenfolgen wie „ignoriere vorherige Anweisungen“ oder Base64-Blöcke hilft, verdächtige Aktivitäten nahezu in Echtzeit zu erkennen.

- Nach Bestätigung eines Angriffs gehen Sie zur Eindämmung über, indem Sie die kompromittierten Komponenten isolieren. Starten Sie neue Sandbox-Instanzen, widerrufen Sie API-Schlüssel, die durch den Prompt offengelegt wurden, und drosseln Sie die Benutzersitzung. Ist Ihr LLM in einen Agenten-Workflow eingebettet, deaktivieren Sie nachgelagerte Konnektoren, bis Sie sicherstellen können, dass diese nicht manipuliert wurden.

- Anschließend führen Sie die Beseitigung durch, indem Sie injizierten Kontext aus Caches oder „Memory“-Funktionen entfernen, verwundbare Systemprompts patchen und Filter feinjustieren, um entdeckte Payload-Varianten zu blockieren. Allgemeine Cybersecurity-Praktiken empfehlen, nach einem Vorfall Anweisungsvorlagen zu aktualisieren, um das Risiko wiederholter Exploits zu verringern.

- Abschließend ziehen Sie Lehren durch ein bereichsübergreifendes Debriefing und einen Rollback-Test mit Security Engineers, Machine-Learning-Spezialisten und Compliance-Verantwortlichen. Branchenexperten empfehlen, einen „Human-in-the-Loop“ einzubinden, um das Modellverhalten nach dem Vorfall zu überprüfen und wiederhergestellte Prompts freizugeben.

Dokumentieren Sie jeden Schritt in einer Incident-Report-Vorlage, die den bösartigen Prompt, den Umfang der Auswirkungen, den Zeitverlauf und die ergriffenen Maßnahmen erfasst. Sicherheitsteams kombinieren das Debriefing häufig mit diesen Tests, um sicherzustellen, dass die Infrastruktur bei erneut destruktiven Prompts sofort zurückgesetzt werden kann.

Angriffe stoppen, bevor sie beginnen

Prompt-Hacking macht Konversationsschnittstellen zu Angriffsvektoren, die traditionelle Sicherheit umgehen. Ähnlich wie Computer-Vision-Systeme dazu gebracht werden können, ein Stoppschild falsch zu klassifizieren, lassen sich Sprachmodelle durch gezielte Eingaben manipulieren.

Die Verteidigung erfordert mehrere Ansätze: Eingabevalidierung, Ausgabe-Filterung, Umgebungsisolation, kontinuierliche Überwachung und adversariales Training. Schnelle Maßnahmen wie parametrisierte Prompts erhöhen sofort das Schutzniveau, während tiefgreifende Investitionen in Sandboxing widerstandsfähige Systeme schaffen.

Behandeln Sie Prompt-Sicherheit als fortlaufende Disziplin, nicht als einmalige Implementierung. Angreifer entwickeln ihre Techniken schnell weiter, um Erkennung zu umgehen. Organisationen, die Sicherheitsüberprüfungen in den KI-Entwicklungszyklus integrieren, bleiben Angreifern voraus, die jede Konversation als potenziellen Kompromiss betrachten.

Die hier beschriebenen Frameworks bieten Ihnen die Grundlage, um Schutzmaßnahmen zu etablieren, bevor der nächste geschickt formulierte Satz Ihre Verteidigung durchbricht.

Prompt Hacking – Häufig gestellte Fragen

Sie verteidigen sich gegen sprachliche Manipulation, nicht gegen bösartigen Code. Angreifer nutzen die Tendenz von LLMs aus, jeden Text als gleichermaßen autoritativ zu behandeln.

Ja. Private Modelle sind denselben Schwachstellen ausgesetzt. Ein Insider oder eine kompromittierte Datenquelle kann versteckte Anweisungen einschleusen, denen das Modell ungefragt folgt.

Prompt-basierte Datenexfiltration führt zu denselben Compliance-Risiken wie jeder andere Vorfall. Ein einziger geleakter Prompt kann DSGVO-, HIPAA- oder ähnliche Strafen auslösen.

Überprüfen Sie Filter, Protokolle und Systemprompts mindestens monatlich oder nach jedem Modell-Update. Bedrohungsakteure entwickeln sich schnell weiter, und KI-gestützte Angriffe beschleunigen sich ständig.

Technisches Verständnis, cross-modale Bedrohungsanalyse und kontinuierliches Red-Teaming sind zentrale Kompetenzen für KI-Sicherheitsrollen.