L'IA viene utilizzata nella nostra vita quotidiana. Con i LLM che dominano ogni ambito, dal lavoro ai compiti scolastici, dall'aiuto con la spesa al calcolo delle tasse, fino a fungere da assistente personale, vengono memorizzate e trasmesse online grandi quantità di informazioni. Gli hacker dei prompt sanno che i LLM non sono sicuri né progettati per esserlo.

Ed è la loro occasione per approfittarne, intercettando tutte queste informazioni sensibili. Basta un solo prompt per indirizzare l'IA nella direzione sbagliata e divulgare accidentalmente i tuoi segreti. In questa guida esploreremo cos'è il prompt hacking. Scoprirai come funziona, come proteggerti e altro ancora qui sotto.

.png)

Che cos'è il Prompt Hacking?

Il prompt hacking è la manipolazione deliberata dei modelli linguistici di IA tramite input appositamente creati per aggirare i controlli di sicurezza o estrarre risposte non previste. Questi attacchi di evasione sfruttano l'incapacità dei large language models (LLM) di distinguere tra istruzioni legittime e comandi malevoli nell'elaborazione del linguaggio naturale, approfittando della tendenza del modello a trattare tutto il testo con la stessa autorevolezza.

Gli aggressori ottengono accesso tramite molteplici punti di ingresso, come chatbot di assistenza clienti, analizzatori di contenuti o feed di dati di terze parti compromessi che la tua IA elabora. Sebbene gli attacchi di prompt injection rappresentino rischi teorici per i modelli addestrati, i chatbot moderni possono implementare barriere di sicurezza per impedire che istruzioni incorporate sovrascrivano la sicurezza a livello di sistema.

Gli attacchi riusciti possono compromettere sistemi proprietari, esporre dati sensibili, eseguire azioni non autorizzate tramite applicazioni collegate e causare danni reputazionali significativi quando i controlli di sicurezza vengono aggirati.

Perché gli attacchi di Prompt Hacking sono un problema

Il prompt hacking aggira le difese di sicurezza tradizionali sfruttando la fiducia intrinseca dell'IA nei dati di input, creando una nuova superficie di attacco che gli strumenti convenzionali non possono proteggere. A differenza delle vulnerabilità basate sul codice, questi attacchi di machine learning avversari manipolano le reti neurali profonde a livello semantico:

- Impatto sul business: Gli attacchi operano dove l'IA elabora il linguaggio, aggirando i firewall per esporre dati di addestramento proprietari o attivare azioni non autorizzate senza lasciare tracce convenzionali.

- Superficie di attacco in espansione: Ogni implementazione di IA crea nuovi punti di ingresso, soprattutto quando i sistemi sono collegati all'infrastruttura di backend.

- Sfide di rilevamento: I prompt malevoli si confondono con le richieste legittime, rendendo inadeguato il rilevamento basato su pattern rispetto a firme SQL riconoscibili.

- Tecniche in evoluzione: Dai semplici comandi "ignora le istruzioni precedenti" ad attacchi di poisoning sofisticati, ogni settimana emergono nuovi metodi di jailbreak.

- Violazioni di conformità: Quando i sistemi IA elaborano dati regolamentati, gli attacchi ai prompt possono costituire una violazione dei dati ai sensi di GDPR o HIPAA.

Questa minaccia emergente richiede ai team di sicurezza di sviluppare competenze che abbraccino sia la cybersecurity tradizionale sia la difesa contro attacchi avversari ai modelli di machine learning.

4 categorie di attacco Prompt Hacking

Il triage degli alert in tempo reale richiede decisioni rapide. Questa matrice mostra le diverse tipologie di attacchi avversari in cui può rientrare il prompt hacking:

| Tipo di attacco | Obiettivo | Tecnica | Segnali di rilevamento |

| Goal Hijacking | Sovrascrivere il flusso di attività previsto | "Ignora tutte le istruzioni precedenti e..." | Cambiamenti improvvisi di contesto, frasi di override |

| Guardrail Bypass | Eludere i filtri di sicurezza | Jailbreak tramite role-playing ("Agisci come assistente senza filtri") | Contenuti proibiti dopo richieste apparentemente innocue |

| Information Leakage | Estrarre prompt di sistema o dati sensibili | Catene di query che richiedono istruzioni interne | Risposte che riecheggiano configurazioni o segreti |

| Infrastructure Attack | Manipolare sistemi collegati | Injection indiretta che attiva comandi shell | Chiamate API o accessi a file inattesi |

Queste categorie spesso si sovrappongono. Ad esempio, un attacco può estrarre segreti e poi attivare chiamate API che compromettono i sistemi di produzione, in modo simile a come funzionano gli attacchi black box nella computer vision quando si creano esempi avversari che inducono le auto a interpretare erroneamente un segnale di stop.

Come prevenire gli attacchi di Prompt Hacking

Proteggere i sistemi IA dal prompt hacking richiede una difesa stratificata e non una soluzione unica. Ecco sei misure protettive che costituiscono uno scudo robusto:

1. Validare e sanificare gli input

Prima che un prompt raggiunga il tuo modello, sottoponilo a un rilevamento di pattern che identifichi frasi di override classiche e codifiche sospette. Implementa controlli regex per pattern di attacco noti e rileva omoglifi Unicode che gli aggressori usano per eludere il rilevamento.

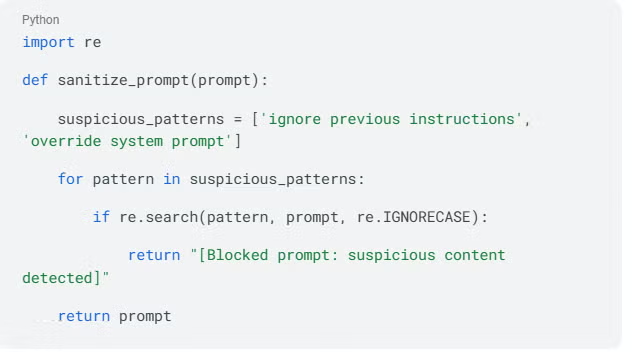

Ecco una semplice funzione Python che implementa un filtro di prompt basato su pattern per intercettare le frasi di attacco più comuni:

L'addestramento avversario con esempi malevoli può rafforzare i tuoi filtri mantenendo basso il tasso di falsi positivi.

L'addestramento avversario con esempi malevoli può rafforzare i tuoi filtri mantenendo basso il tasso di falsi positivi.

2. Parametrizzare le istruzioni di sistema

Separa chiaramente il testo dell'utente dalle istruzioni di sistema utilizzando delimitatori espliciti. Racchiudi gli input dell'utente in marcatori (ad es. <|user|>{input}<|end|>) per evitare che il modello confonda contenuti non attendibili con comandi privilegiati.

Tecniche di distillazione difensiva possono aiutare i modelli di machine learning a resistere alla manipolazione dei dati di input.

3. Filtrare e post-processare gli output

Ogni risposta del modello deve passare attraverso più livelli di sicurezza prima della consegna. Implementa classificatori di tossicità e motori di policy che possano rifiutare contenuti che violano gli standard. Aggiungi controlli stateful che monitorano il "guardrail probing", dove gli attaccanti white box aumentano gradualmente i privilegi.

4. Isolare gli ambienti LLM

Ospita i modelli linguistici in container dedicati, completamente separati dai data store principali. Instrada tutte le chiamate API tramite proxy con ambito ristretto che limitano l'accesso alle risorse esterne. Questo isolamento garantisce che, anche se un aggressore manipola il modello per tentare un comando shell o una esfiltrazione di dati, il sandbox ne impedisce l'esecuzione.

5. Implementare controlli di minimo privilegio

Concedi ai LLM solo le credenziali minime: accesso in sola lettura alle knowledge base e nessun permesso amministrativo. Usa chiavi API a breve durata e RBAC granulare per garantire che eventuali attacchi ai prompt non possano scalare verso sistemi di maggior valore.

6. Monitorare continuamente le anomalie

Considera ogni interazione con il LLM come un evento di sicurezza, registrando prompt e risposte in uno storage immutabile. Invia questa telemetria ai tuoi sistemi di monitoraggio della sicurezza per identificare pattern insoliti. La SentinelOne Singularity Platform esemplifica questo approccio automatizzando il rilevamento e riducendo il volume degli alert dell'88%.

Piattaforma Singularity

Elevate la vostra posizione di sicurezza con il rilevamento in tempo reale, la risposta automatica e la visibilità totale dell'intero ambiente digitale.

Richiedi una demoStrategie di rilevamento e recupero

Archivia prompt, identificativi utente, timestamp e risposte del modello in uno storage sicuro per poter riprodurre le sessioni e tracciare come le istruzioni malevole sono passate inosservate. Invia i log al tuo SIEM e implementa regole che evidenzino le firme di attacco:

- Payload offuscati: Lunghe stringhe Base64 spesso segnalano tentativi di occultare istruzioni nascoste

- Override di contesto: Frasi come "ignora tutte le istruzioni precedenti"

- Volume anomalo: Picchi improvvisi di invii da una singola chiave API

Quando un attacco viene confermato, isola i componenti compromessi, revoca le chiavi API esposte e disabilita i connettori downstream. Elimina qualsiasi contesto iniettato dalle cache, correggi i prompt di sistema vulnerabili e affina i filtri per bloccare le varianti di payload individuate. Documenta ogni passaggio in un template di incident report.

Playbook di risposta e recupero dagli incidenti

Anche con difese robuste, un aggressore determinato può comunque superare le tue barriere. Quando ciò accade, serve un playbook che sia rapido quanto l'exploit.

- Inizia con l'identificazione individuando il prompt malevolo. Il logging continuo di ogni richiesta e risposta ti consente di tracciare la catena di istruzioni seguita dal modello. Il pattern matching su stringhe indicative come "ignora le istruzioni precedenti" o blob base64 ti aiuta a segnalare attività sospette quasi in tempo reale.

- Una volta confermato l'attacco, passa al contenimento isolando i componenti compromessi. Avvia nuove istanze sandbox, revoca le chiavi API che il prompt potrebbe aver esposto e limita la sessione utente. Se il tuo LLM è integrato in un workflow di agenti, disabilita i connettori downstream finché non puoi verificare che non siano stati manipolati.

- Successivamente, esegui l'eradicazione eliminando qualsiasi contesto iniettato da cache o funzionalità di "memoria", correggendo i prompt di sistema vulnerabili e affinando i filtri per bloccare le varianti di payload scoperte. Le best practice di cybersecurity raccomandano di aggiornare i template di istruzioni dopo una violazione come parte della difesa stratificata, il che può aiutare a ridurre il rischio di exploit ripetuti.

- Infine, concludi con le lezioni apprese tramite un debrief cross-funzionale e un rollback test che coinvolga ingegneri di sicurezza, specialisti di machine learning e responsabili della compliance. Gli esperti del settore raccomandano di mantenere un "human in the loop" per revisionare il comportamento del modello dopo l'incidente e approvare i prompt ripristinati.

Documenta ogni passaggio in un template di incident report che includa il prompt malevolo, l'ambito dell'impatto, la timeline e le azioni correttive. I team di sicurezza spesso abbinano il debrief a questi test per garantire che l'infrastruttura possa essere ripristinata istantaneamente se un prompt dovesse nuovamente causare cambiamenti distruttivi.

Fermare gli attacchi prima che inizino

Il prompt hacking trasforma le interfacce conversazionali in vettori di attacco che aggirano la sicurezza tradizionale. Così come i sistemi di computer vision possono essere ingannati nel classificare erroneamente un segnale di stop, i modelli linguistici possono essere manipolati tramite input appositamente creati.

La difesa richiede approcci multipli: validazione degli input, filtraggio degli output, isolamento degli ambienti, monitoraggio continuo e addestramento avversario. Soluzioni rapide come i prompt parametrizzati alzano subito il livello di sicurezza, mentre investimenti più profondi nel sandboxing creano sistemi resilienti.

Considera la sicurezza dei prompt come una disciplina continua, non come un'implementazione una tantum. Gli aggressori iterano rapidamente, creando nuove tecniche per eludere il rilevamento. Le organizzazioni che integrano le revisioni di sicurezza nei cicli di sviluppo dell'IA resteranno avanti rispetto agli avversari che vedono ogni conversazione come una potenziale compromissione.

I framework illustrati qui ti forniscono le basi per costruire una protezione prima che la prossima frase abilmente costruita abbatta le tue difese.

Domande frequenti sul Prompt Hacking

Si tratta di difendersi dalla manipolazione linguistica, non da codice dannoso. Gli aggressori sfruttano la tendenza del LLM a trattare ogni testo come ugualmente autorevole.

Sì. I modelli privati presentano le stesse vulnerabilità. Un insider o una fonte dati compromessa può iniettare istruzioni nascoste che il modello esegue senza obiezioni.

L’esfiltrazione di dati tramite prompt comporta le stesse responsabilità di conformità di qualsiasi altra violazione. Un singolo prompt divulgato può attivare sanzioni GDPR, HIPAA o simili.

Verifica filtri, log e prompt di sistema almeno mensilmente o dopo ogni aggiornamento del modello. Gli attori delle minacce iterano rapidamente e gli attacchi assistiti dall’IA accelerano costantemente.

Competenze ingegneristiche, analisi delle minacce cross-modale e red-teaming continuo rappresentano competenze fondamentali per i ruoli di sicurezza IA.