La IA se utiliza en nuestra vida cotidiana. Con los LLM dominando todas las áreas, desde el trabajo, tareas escolares, ayuda con las compras, cálculo de impuestos o simplemente como asistente personal, almacena y transmite mucha información en línea. Los hackers de prompts saben que los LLM no son seguros ni están diseñados para serlo.

Y es su oportunidad de aprovecharse secuestrando toda esa información sensible. Un solo prompt es suficiente para desviar la IA en la dirección equivocada y revelar tus secretos por accidente. En esta guía, exploraremos qué es el prompt hacking. A continuación, sabrás cómo funciona, cómo protegerte y más.

.png)

¿Qué es el Prompt Hacking?

El prompt hacking es la manipulación deliberada de modelos de lenguaje de IA mediante entradas cuidadosamente diseñadas para anular controles de seguridad o extraer respuestas no intencionadas. Estos ataques de evasión explotan la incapacidad de los modelos de lenguaje grande (LLM) para distinguir entre instrucciones legítimas y comandos maliciosos en el procesamiento de lenguaje natural, aprovechando la tendencia del modelo a tratar todo el texto con la misma autoridad.

Los atacantes obtienen acceso a través de múltiples puntos de entrada, como chatbots de soporte al cliente, analizadores de contenido o fuentes de datos de terceros comprometidas que tu IA consume. Si bien los ataques de inyección de prompts representan riesgos teóricos para los modelos entrenados, los chatbots modernos pueden implementar límites de seguridad para evitar que las instrucciones incrustadas anulen la seguridad a nivel de sistema.

Los ataques exitosos pueden resultar en la vulneración de sistemas propietarios, exposición de datos sensibles, acciones no autorizadas a través de aplicaciones conectadas y daños significativos a la reputación cuando se eluden los controles de seguridad.

Por Qué los Ataques de Prompt Hacking Son un Problema

El prompt hacking elude las defensas de seguridad tradicionales al explotar la confianza inherente de la IA en los datos de entrada, creando una superficie de ataque completamente nueva que las herramientas convencionales no pueden proteger. A diferencia de las vulnerabilidades basadas en código, estos ataques adversarios de aprendizaje automático manipulan redes neuronales profundas a nivel semántico:

- Impacto en el negocio: Los ataques operan donde la IA procesa el lenguaje, eludiendo firewalls para exponer datos de entrenamiento propietarios o desencadenar acciones no autorizadas sin dejar firmas convencionales.

- Superficie de ataque en expansión: Cada implementación de IA crea nuevos puntos de entrada, especialmente cuando los sistemas se conectan a la infraestructura de backend.

- Desafíos de detección: Los prompts maliciosos se mezclan con solicitudes legítimas, haciendo que la detección basada en patrones sea inadecuada en comparación con firmas reconocibles como las de SQL.

- Técnicas en evolución: Desde simples comandos de "ignorar instrucciones previas" hasta sofisticados ataques de envenenamiento, cada semana surgen nuevos métodos de jailbreak.

- Violaciones de cumplimiento: Cuando los sistemas de IA procesan datos regulados, los ataques de prompt pueden constituir una brecha de datos bajo GDPR o HIPAA.

Esta amenaza emergente requiere que los equipos de seguridad desarrollen experiencia tanto en ciberseguridad tradicional como en defensa contra ataques adversarios para modelos de aprendizaje automático.

4 Categorías de Ataques de Prompt Hacking

La gestión en tiempo real de alertas exige decisiones rápidas. Esta matriz muestra los diferentes tipos de categorías de ataques adversarios en los que puede caer el prompt hacking:

| Tipo de ataque | Objetivo | Técnica | Señales de detección |

| Secuestro de objetivo | Anular el flujo de tareas previsto | "Ignora todas las instrucciones previas y..." | Cambios repentinos de contexto, frases de anulación |

| Elusión de límites de seguridad | Evadir filtros de seguridad | Jailbreaks de roles ("Actúa como asistente sin filtros") | Contenido prohibido tras consultas benignas |

| Fuga de información | Extraer prompts del sistema o datos sensibles | Cadenas de consultas solicitando instrucciones internas | Respuestas que repiten configuraciones o secretos |

| Ataque a la infraestructura | Manipular sistemas conectados | Inyección indirecta que desencadena comandos de shell | Llamadas API inesperadas o acceso a archivos |

Estas categorías suelen combinarse. Por ejemplo, un ataque puede extraer secretos y luego desencadenar llamadas API que comprometen sistemas de producción, similar a cómo funcionan los ataques de caja negra en visión por computadora al crear ejemplos adversarios que hacen que los autos interpreten mal una señal de alto.

Cómo Prevenir Ataques de Prompt Hacking

Proteger los sistemas de IA contra el prompt hacking requiere una defensa en profundidad en lugar de una única solución. Estas son seis medidas de protección que forman un escudo robusto:

1. Validar y Sanitizar Entradas

Antes de que un prompt llegue a tu modelo, pásalo por una detección de patrones que identifique frases clásicas de anulación y codificaciones sospechosas. Implementa comprobaciones regex para patrones de ataque conocidos y detecta homógrafos Unicode que los atacantes usan para evadir la detección.

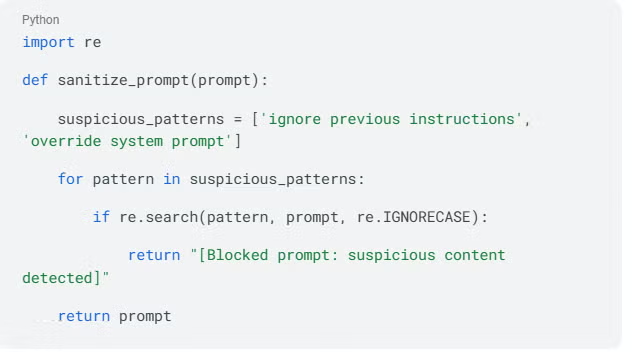

Esta es una función simple en Python que implementa un filtrado básico de prompts basado en patrones para detectar frases de ataque comunes:

El entrenamiento adversario con ejemplos maliciosos puede fortalecer tus filtros manteniendo bajas las tasas de falsos positivos.

El entrenamiento adversario con ejemplos maliciosos puede fortalecer tus filtros manteniendo bajas las tasas de falsos positivos.

2. Parametrizar Instrucciones del Sistema

Separa claramente el texto del usuario de las instrucciones del sistema usando delimitadores explícitos. Encierra las entradas del usuario en marcadores (por ejemplo, <|user|>{input}<|end|>) para evitar que el modelo confunda contenido no confiable con comandos privilegiados.

Técnicas de destilación defensiva pueden ayudar a los modelos de aprendizaje automático a resistir la manipulación de los datos de entrada.

3. Filtrar y Posprocesar Salidas

Pasa cada respuesta del modelo por múltiples capas de seguridad antes de entregarla. Implementa clasificadores de toxicidad y motores de políticas que puedan rechazar contenido que viole los estándares. Añade comprobaciones con estado que monitoreen la "prueba de límites de seguridad" donde los atacantes de caja blanca escalan privilegios gradualmente.

4. Aislar Entornos LLM

Aloja los modelos de lenguaje en contenedores dedicados, completamente separados de los almacenes de datos principales. Redirige todas las llamadas API a través de proxies con alcance restringido que limiten el acceso a recursos externos. Este aislamiento garantiza que, incluso si un atacante manipula el modelo para intentar un comando de shell o exfiltración de datos, el sandbox impide la ejecución.

5. Implementar Controles de Mínimos Privilegios

Concede a los LLM solo credenciales mínimas: acceso de solo lectura a bases de conocimiento y sin permisos administrativos. Usa claves API de corta duración y RBAC granular para asegurar que los ataques de prompt exitosos no puedan escalar a sistemas de mayor valor.

6. Monitorear Continuamente en Busca de Anomalías

Trata cada interacción con LLM como un evento de seguridad registrando prompts y respuestas en almacenamiento inmutable. Alimenta esta telemetría en tus sistemas de monitoreo de seguridad existentes para identificar patrones inusuales. La SentinelOne Singularity Platform ejemplifica este enfoque automatizando la detección y reduciendo el volumen de alertas en un 88%.

Plataforma Singularity

Mejore su postura de seguridad con detección en tiempo real, respuesta a velocidad de máquina y visibilidad total de todo su entorno digital.

DemostraciónEstrategias de Detección y Recuperación

Almacena prompts, identificadores de usuario, marcas de tiempo y respuestas del modelo en almacenamiento seguro para reproducir sesiones y rastrear cómo se filtraron instrucciones maliciosas. Envía los registros a tu SIEM y despliega reglas que destaquen firmas de ataque:

- Payloads ofuscados: Cadenas grandes en Base64 suelen indicar intentos de ocultar instrucciones

- Anulación de contexto: Frases como "ignora todas las instrucciones previas"

- Volumen anómalo: Picos repentinos en envíos desde una sola clave API

Cuando se confirma un ataque, aísla los componentes comprometidos, revoca las claves API expuestas y deshabilita los conectores descendentes. Elimina cualquier contexto inyectado de las cachés, corrige los prompts del sistema vulnerables y ajusta los filtros para bloquear variantes de payload detectadas. Documenta cada paso en una plantilla de informe de incidentes.

Guía de Respuesta y Recuperación ante Incidentes

Aun con defensas robustas, un atacante determinado puede superar tus límites de seguridad. Cuando eso ocurra, necesitas una guía que actúe tan rápido como el exploit.

- Comienza con la identificación detectando el prompt malicioso. El registro continuo de cada solicitud y respuesta te permite rastrear la cadena exacta de instrucciones que siguió el modelo. La búsqueda de patrones de cadenas características como "ignorar instrucciones previas" o blobs en base64 te ayuda a señalar actividad sospechosa en tiempo casi real.

- Una vez confirmado el ataque, pasa a la contención aislando los componentes comprometidos. Inicia nuevas instancias sandbox, revoca las claves API que el prompt pudo haber expuesto y limita la sesión del usuario. Si tu LLM está integrado en un flujo de trabajo de agente, deshabilita los conectores descendentes hasta verificar que no fueron manipulados.

- A continuación, ejecuta la erradicación eliminando cualquier contexto inyectado de cachés o funciones de "memoria", corrigiendo los prompts del sistema vulnerables y ajustando los filtros para bloquear las variantes de payload detectadas. Las prácticas generales de ciberseguridad recomiendan actualizar las plantillas de instrucciones tras una brecha como parte de la defensa en profundidad, lo que puede ayudar a reducir el riesgo de exploits repetidos.

- Por último, finaliza con lecciones aprendidas mediante una revisión transversal y una prueba de reversión que involucre a ingenieros de seguridad, especialistas en aprendizaje automático y responsables de cumplimiento. Los expertos de la industria recomiendan mantener un "humano en el circuito" para revisar el comportamiento del modelo tras el incidente y aprobar los prompts restaurados.

Documenta cada paso en una plantilla de informe de incidentes que incluya el prompt malicioso, el alcance del impacto, la línea de tiempo y las acciones correctivas. Los equipos de seguridad suelen combinar la revisión con estas pruebas para asegurar que la infraestructura pueda revertirse instantáneamente si un prompt vuelve a desencadenar cambios destructivos.

Detén los Ataques Antes de que Comiencen

El prompt hacking convierte las interfaces conversacionales en vectores de ataque que eluden la seguridad tradicional. De manera similar a cómo los sistemas de visión por computadora pueden ser engañados para clasificar erróneamente una señal de alto, los modelos de lenguaje pueden ser manipulados mediante entradas cuidadosamente diseñadas.

La defensa requiere múltiples enfoques: validación de entradas, filtrado de salidas, aislamiento de entornos, monitoreo continuo y entrenamiento adversario. Acciones rápidas como prompts parametrizados elevan el nivel de protección de inmediato, mientras que inversiones más profundas en sandboxing crean sistemas resilientes.

Trata la seguridad de los prompts como una disciplina continua, no como una implementación única. Los atacantes iteran rápidamente, creando nuevas técnicas para evadir la detección. Las organizaciones que integran revisiones de seguridad en los ciclos de desarrollo de IA se mantendrán por delante de los adversarios que ven cada conversación como una posible vulneración.

Los marcos aquí descritos te dan la base para construir protección antes de que la próxima frase cuidadosamente elaborada derribe tus defensas.

Preguntas frecuentes sobre Prompt Hacking

Está defendiendo contra la manipulación lingüística, no contra código malicioso. Los atacantes explotan la tendencia del LLM a tratar cada fragmento de texto como igualmente autorizado.

Sí. Los modelos privados enfrentan las mismas vulnerabilidades. Un usuario interno o una fuente de datos comprometida puede inyectar instrucciones ocultas que el modelo sigue sin cuestionar.

La exfiltración de datos basada en prompts genera las mismas responsabilidades de cumplimiento que cualquier otra brecha. Un solo prompt filtrado puede activar sanciones bajo GDPR, HIPAA o normativas similares.

Revise los filtros, registros y prompts del sistema al menos mensualmente o después de cualquier actualización del modelo. Los actores de amenazas iteran rápidamente y los ataques asistidos por IA se aceleran constantemente.

La alfabetización en ingeniería, el análisis de amenazas multimodales y el red-teaming continuo representan competencias clave para roles de seguridad en IA.